Künstliche Intelligenz-Verordnung (AI Act) verabschiedet

#ArtificialIntelligence #AIAct #ITGovernance #GenAI

Am 21. Mai 2024 hat der Rat der Europäischen Union die KI-Verordnung (AI Act) verabschiedet. Das Gesetz definiert einheitliche Richtlinien für die Entwicklung und Nutzung von künstlicher Intelligenz in der Europäischen Union. Es handelt sich um den kodifizierten Standard zur Entwicklung und dem Einsatz von Künstlicher Intelligenz (KI).

Die Zielsetzung besteht in der Schaffung von Regeln für die verantwortungsvolle und rechtskonforme Entwicklung und Anwendung von KI. Dazu gehören auch strikte Regeln für Hochrisikosysteme sowie ein Verbot gewisser Anwendungsfälle. Auch wenn Sie KI bisher nur in geringem Umfang genutzt haben, besteht dringender Handlungsbedarf: Die Übergangsfristen bis spätestens Mitte 2026 sind kurz gestaffelt.

Die EU verfolgt dabei im Rahmen des AI Acts einen risikobasierten Ansatz. Je höher die Wahrscheinlichkeit negativer Effekte auf Gesundheit, Sicherheit oder Grundrechte durch ein KI-System, desto stärker wird es reguliert. KI-Systeme, deren Nutzung im Widerspruch zu Grundrechten oder EU-Werten steht, werden ganz verboten.

Unannehmbares Risiko:

KI-Systeme, die Grundrechte verletzen und im Widerspruch zu EU-Werten stehen werden verboten

Die EU verbietet bestimmte KI-Praktiken, wie zum Beispiel KI-Systeme, die menschliches Verhalten beeinflussen, oder KI-Systeme, die Personen anhand von Social Scoring oder Emotionserkennung am Arbeitsplatz beurteilen. Dieses Verbot unterstreicht die Intention der EU, ihre Bürger vor potenziell schädlichen Effekten einer KI zu schützen.

Hohes Risiko:

NUTZUNG VON KI-SYSTEMEN, DIE BEI VERSAGEN ODER BEI MISSBRAUCH EINEN HOHEN SCHADEN AN MENSCHEN, DEREN GRUNDRECHTEN, DER WIRTSCHAFT ODER DER UMWELT VERURSACHEN KÖNNEN

Für die Entwicklung, Bereitstellung und Nutzung von hochrisikobehafteten KI-Systemen gelten strenge Anforderungen an Datenschutz, Datenqualität, Sicherheit und Dokumentation.

Mit dem AI Act muss Konformität nachgewiesen werden. Ein präventives Risikomanagement findet durch ein implementiertes Qualitäts-Management-Verfahren und ein Verfahren zur Validierung des KI-Systems statt.

Von hoher Bedeutung ist die Haftbarkeit des anwendenden Unternehmens im Falle fehlerhafter Ergebnisse der KI-Systeme. Als Kontrollanforderung gilt in derart gelagerten Fällen, dass ein Hochrisiko-KI-System von einem Menschen überwacht werden muss. Die technischen Schlagworte „Explainability“ und „Interpretability“ werden somit in der Modellentwicklung immer wichtiger!

NIEDRIGES RISIKO:

EIN KI-SYSTEM ODER DESSEN ERGEBNISSE MÜSSEN ALS KI-GENERIERT GEKENNZEICHNET SEIN

KI-Systeme, die nicht in die zuvor erwähnten Kategorien fallen, profitieren von weniger strengen Regulierungsanforderungen.

Wenn KI-Systeme mit Menschen interagieren, müssen die Anbieter und Betreiber darüber informieren, wie die Inhalte oder Entscheidungen entstanden sind. Das gilt zum Beispiel für Chatbots und Deepfakes. Dieses aktive Erfordernis entfällt, wenn es aus dem Kontext ersichtlich ist. In diesen Fällen gelten auch andere gesetzliche Regeln, zum Beispiel zum Datenschutz.

KI-Systeme mit allgemeinem Verwendungszweck („General Purpose AI“ – GPAI) unterliegen ebenfalls einer Regulierung. Darunter fallen KI-Systeme, welche vom Anbieter entwickelt wurden, um allgemein anwendbare Funktionen (bspw. Bild- und Spracherkennung oder Textgenerierung) auszuführen und zunächst unabhängig vom konkreten Anwendungsfall sind.

Grundsätzlich werden technische Dokumentation, Transparenz bezüglich verwendeter Trainingsdaten und weitere Anforderungen zum Risikomanagement sowie zur Cyber-Security vorausgesetzt. Je nach benötigter Rechenkapazität zum Trainieren des Modells können KI gestützte Systeme als Hochrisiko-KI-Systeme klassifiziert werden.

Durch den AI-Act schafft die EU vor allem Rechtssicherheit, mit der die Entwicklung und die Einführung von KI-Systemen in Unternehmen befördert werden kann. Damit KI-Systeme aber erfolgreich (weiter)entwickelt und in Unternehmen eingesetzt werden, sind klare Regeln für Ihr Unternehmen und dessen Mitarbeiter notwendig.

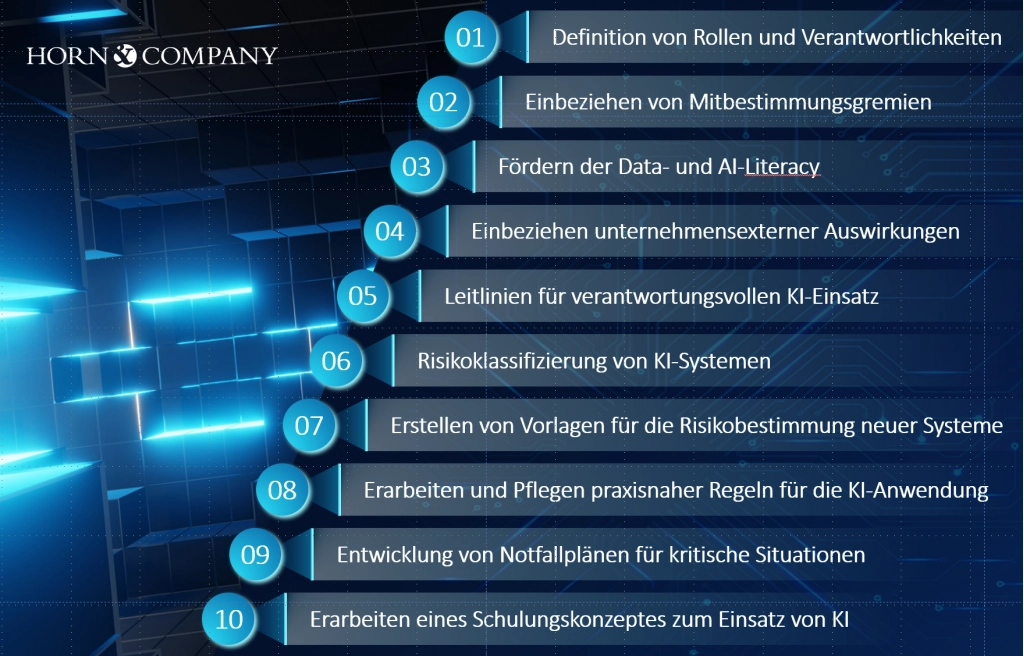

Hilfreiche Orientierung für Sie bietet unser Dekalog für die Einführung einer KI-Governance.

IN 10 SCHRITTEN ZUR KI-GOVERNANCE FÜR UNTERNEHMEN:

- Definieren Sie klare Rollen und Verantwortlichkeiten. Vernetzen Sie Digital-, IT- Legal- Information Security – und Data Protection Officers Ihres Unternehmens in einer ganzheitlichen Aufbau- und Ablauforganisation.

- Beziehen Sie Mitbestimmungsgremien frühzeitig ein, um Unterstützung sicherzustellen und die Akzeptanz der Regelungen zu vereinfachen.

- Erklären Sie KI mit praktischen Beispielen, um ein unternehmensweites Verständnis der Technologie zu fördern.

- Eine unterschätzte Konsequenz des AI-Acts ist es, dass Wissen über KI von mehr Funktionen innerhalb des Unternehmens nötig wird. „Data-/AI-Literacy“ ist nicht mehr nur ein Erfolgsfaktor, sondern wurde zur regulatorischen Notwendigkeit!

- Beziehen Sie in der Erarbeitung der KI-Governance geografische, verfahrenstechnische und rechtliche Auswirkungen mit ein. Unterschätzen Sie nicht mögliche Auswirkungen auf Lieferanten und Dienstleister!

- Erarbeiten Sie Leitlinien für den ethisch verantwortungsvollen Einsatz von KI im Einklang mit Ihren Unternehmenswerten. Definieren Sie klare „rote Linien“ für Anwendungsfälle.

- Beziehen Sie Fachexperten, KI-Experten und Mitarbeiter in die Risikoklassifikation der KI-Systeme mit ein. Verzahnen Sie diesen Prozess mit Ihrem RKS/IKS-Prozess.

- Erleichtern Sie die Einführung von neuen KI-Systemen. Halten Sie definierte Vorlagen für die Risikobewertung neuer KI-Systeme bereit.

- Geben Sie praxisnahe Regeln für den Einsatz von KI in der täglichen Anwendung.

- Definieren Sie die Konsequenzen von Verstößen gegen die Governance. Entwickeln Sie außerdem Notfallpläne für kritische Situationen.

- Stellen Sie durch Schulungen und wirksamer Kommunikation sicher, dass Regeln der KI-Governance bekannt sind und eingehalten werden.

Synergien entstehen, wenn Aktivitäten im Rahmen des AI-Act mit anderen regulatorischen Projekten wie NIS-2, DORA und DSGVO abgestimmt werden. Dies verhindert doppelte Arbeit und fördert einen ganzheitlichen Blick auf die IT-Landschaft des Unternehmens.

Wir bieten umfassende Beratung und maßgeschneiderte Lösungen, die von der Reifefeststellung über Risikobewertung bis hin zur Implementierung von Best Practices reichen. Unser Expertenteam hilft Ihnen, die Vorteile der KI-Technologie voll auszuschöpfen, während Sie gleichzeitig die gesetzlichen Vorgaben einhalten. Lassen Sie uns gemeinsam sicherstellen, dass Sie und Ihr Unternehmen nicht nur konform, sondern auch innovativ und zukunftssicher bleiben!